Grand Canyon: een dag uit het leven van paardentrainer Karen

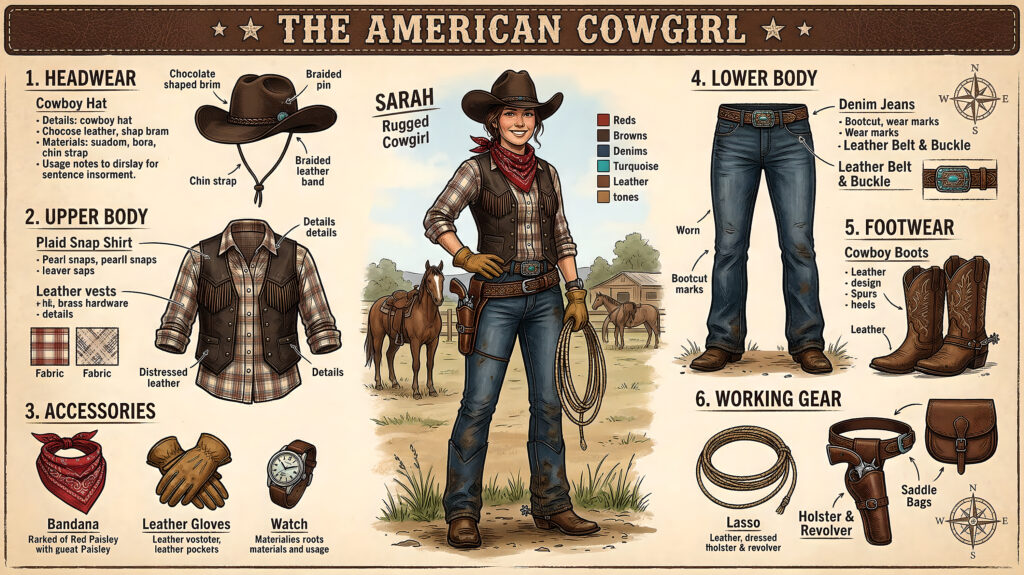

“Grand Canyon” is mijn nieuwste AI-videocreatie. Ik wilde iets met de fraaie Grand Canyon visualiseren en bedacht Karen, een cowgirl die paarden traint in dat magische landschap. Haar familie runt daar een veeboerderij.

At peace op de prairie

Alles begint met inspiratie en een idee dat je verder uitwerkt. In mijn favoriete lifestylemagazine, de Nederlandse Vogue Living (januari/februari 2026), las ik het artikel ‘At Peace op de Prairie’, een interview met Lois Schindeler, met schitterende foto’s. Zo ontstond het idee, en daar eindigt ook elke vergelijking. Behalve dat Lois op de cover van Vogue Living gehurkt op een paard staat afgebeeld. Wat een meesterlijk shot! Karen heb ik ook in een soortgelijk shot in de video opgenomen.

Face drifting

Bij AI-beeldcreatie loop je tegen allerlei problemen aan, zoals snelle beeldbewegingen en het behouden van een consistent personage. Geregeld komt ‘face drifting’ voor: het gezicht verandert en lijkt soms te vervormen. Dat is hinderlijk en vergt iteraties. Al wordt de AI-technologie ook daarin steeds beter.

Een lastig onderwerp qua visualisatie en beweging

Voor mij als producent is het een uitdaging om een lastig onderwerp als dit aan te pakken: een paardentrainer die met haar paard galoppeert. Ook moeten de paarden op elkaar blijven lijken. Hetzelfde geldt voor de omgeving, het landschap.

Nano Banana

Het AI-project begon met de creatie van de hoofdpersoon Karen. Tot voor kort werkte ik met OpenArt van OpenAI om een consistent personage te maken. Sinds Nano Banana, het AI-model dat beelden almaar beter (lees: realistischer) maakt, heb ik Karen daarmee gecreëerd, om precies te zijn in Nano Banana 2. In de video zijn twee cowgirls te zien: Karen en haar vriendin Joleen, waarmee ze te paard door de Grand Canyon trekken.

De keyframes

In Nano Banana 2 zijn de keyframes gemaakt: de statische beelden die de hoofdelementen van het verhaal in beeld brengen. Die moeten daarna in bewegende videobeelden worden omgezet, waarbij prompting van doorslaggevend belang is: de tekstinstructies voor het AI-videomodel. Ik ben een grote liefhebber van Kling AI. Bijna al mijn cinematografische, fotorealistische werk breng ik tot leven met Kling AI, versie 2.6. Nog niet zo lang geleden verscheen versie 3.0 waaraan ik nog niet ben toegekomen.

Elke dag studie

AI vergt iedere dag studietijd inruimen. De AI-technologie verandert bijna met het uur, zo snel gaan de ontwikkelingen. Dat maakt het razend interessant voor zo’n oude producent als ik.

Van keyframe naar video scène

Tijdens het omzetten van de keyframes naar de videoscènes liep ik tegen veel problemen aan. Hoe meer en sneller iets beweegt in de AI-gegenereerde video, hoe lastiger het wordt.

Hoe breng je iets in beeld

Beeldkadrering is van doorslaggevend belang: hoe breng je iets in beeld? Een (ultra) wijds shot, een medium shot, close-up of juist een drone-shot? De weersgesteldheid, het zonlicht, de wolken: alles moet je ‘in de hand hebben’ en dus regisseren. Als producent moet ik het AI-model precies en gedetailleerd instrueren wát ik wil zien. Afwisseling in de kadrering maakt een video levendig, alleen wijdse shots vervelen de kijker snel.

Petroleumlampen: liever niet!

Een ander aandachtspunt was de verlichting van de paardenstallen. De AI vulde dit zelf in met petroleumlampen, maar die zie je daar waarschijnlijk niet, puur vanwege het brandgevaar. Zo zijn er talloze details waarop je als AI-creator moet letten. Karen draagt vaak haar lasso bij zich, dus moet ik de AI instrueren dit niet altijd te tonen. Soms haalde Karen ineens een tweede lasso ‘uit het niets’ tevoorschijn. AI fantaseert graag; dat noemt men hallucineren. Alles wat langer duurt dan vijf seconden vraagt om dat soort problemen.

Toevoegen van geluidseffecten

Het is mogelijk om audio door de AI bij de videoscène te laten maken, maar in negen van de tien gevallen levert dat voor mij niet het gewenste resultaat op. Daarom maak en voeg ik geluidseffecten zelf toe via ander softwarepakket, Epidemic Sound, waarmee ik de geluiden samenstel. Aan het einde van de video komen coyotes voor. Ik wist niet zeker of er in de Grand Canyon bomen en groen voorkomen. Dat blijkt wel het geval te zijn, zodat ik het eindshot niet hoefde aan te passen.

Poster van de video

Met Nano Banana is ook de poster voor deze video gemaakt. De songtekst heb ik, zoals bij al mijn video’s, zelf geschreven, hier en daar met de hulp van ChatGPT. SUNO AI behoort tot mijn favoriete AI-pakketten/technologieën. Zorgvuldig kies ik de zangstem(men), de muzieksoort, de muziekinstrumenten, het tempo en de sfeer. Ik pas soms

songteksten aan zodat ze goed in het gehoor liggen. Nee, ik maak niets op rijm.

Songteksten vertalen

Met ChatGPT vertaal ik mijn songteksten naar het Engels/Amerikaans, of dat 100% correct is, weet ik niet helemaal zeker. De song moet ook een bepaalde lengte hebben. Voor ‘Grand Canyon’ heb ik twee keer nieuwe keyframes moeten aanmaken en in videoscènes omzetten om het geheel mooi passend te krijgen.

Productietijd

In totaal heb ik zes volle dagen aan deze videoproductie gewerkt, inclusief één dag videomontage en audio-nabewerking. Wanneer ik het eindresultaat meerdere malen bekijk, geeft dat mij een heerlijk gevoel: vanuit niets met AI dit realiseren en visualiseren, elk beeld zélf bedacht en gemaakt, elke songtekst. Al decennialang produceer ik fotografische beelden en videoclips, maar nog nooit heb ik daar zoveel plezier aan beleefd als nu met behulp van de AI-technologie.

Het nieuwe project

Mijn volgende productie ligt al gereed, alle beelden en videoscènes zijn al klaar. Het onderwerp: een muziekvideo uit de jaren dertig van de vorige eeuw. Wederom een lastig project voor AI: lip-sync zang is het moeilijkst om te realiseren. Dat ziet u binnenkort.